리벨리온 NPU에서 직접 경험한 LLM 추론의 새로운 가능성

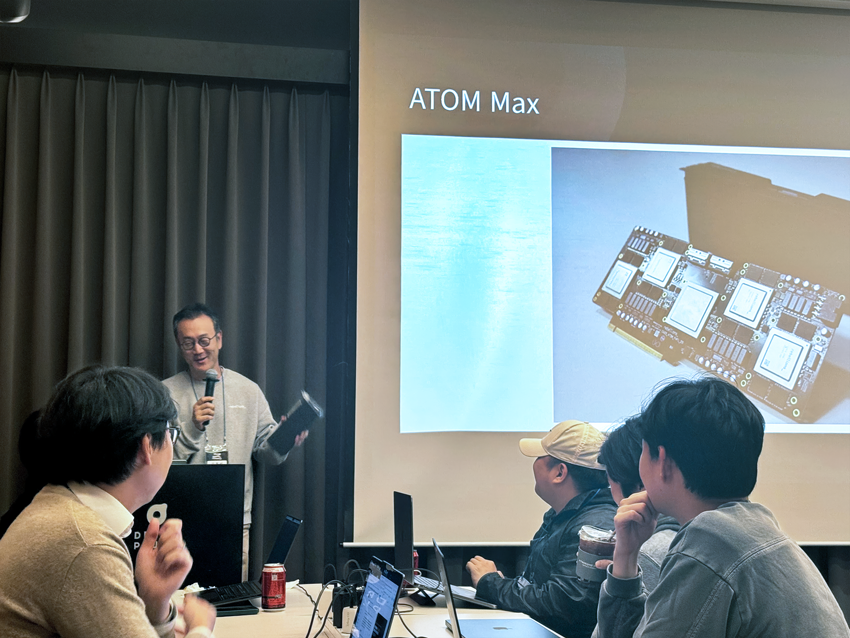

지난 8월 vLLM Korea Meetup에 이어, 10월 29일 리벨리온과 스퀴즈비츠 주관으로 vLLM Hands-on Workshop을 개최했습니다. 국내 NPU 기업이 AI 개발자를 초청해 실습 중심의 워크숍을 진행한 것은 이번이 처음입니다. 실제로 접하기 어려웠던 NPU와 vLLM 기반 추론을 직접 체험해 볼 수 있는 자리였습니다.

NPU에 대한 궁금증을 해소하는 자리

워크숍 이후 진행된 만족도 조사 결과, 참가자 전원이 “만족” 이상으로 응답했습니다. 가장 인상 깊었던 부분으로는 단연 리벨리온 NPU를 직접 활용해 vLLM을 구동해본 경험이 꼽혔습니다. 참가자들은 PyTorch 기반 코드 흐름이 익숙하다면 별도의 환경 설정 없이도 실습을 쉽게 따라갈 수 있었다고 평가했습니다. 또한 이번 워크숍은 그동안 품고 있던 주요 기술적 궁금증에 대한 해답을 얻는 자리이기도 했습니다.

- NPU를 도입하면 기존 코드나 MLOps 파이프라인에 큰 변경이 필요한가?

- Hugging Face, PyTorch, vLLM으로 이어지는 개방형 AI 기술 스택과 NPU의 통합 수준은 어느 정도인가?

- 복잡한 MoE 모델의 분산 추론을 어떻게 효율적으로 NPU에서 처리할 수 있는가?

이를 통해 참가자들은 리벨리온 NPU가 개발자 친화적이면서도 고효율적인 AI 추론 인프라로 빠르게 발전하고 있음을 직접 확인했습니다.

익숙한 개발자 경험(DX)

리벨리온은 원활한 실습 진행을 위해 ATOMTM NPU 서버를 기반으로 실습 환경을 구축했습니다. 참가자들은 쿠버네티스(Kubernetes) 기반으로 NPU 리소스 풀에 연결된 개별 서버에 접속하여 실습을 진행했습니다.

첫 세션은 PyTorch의 Eager Mode를 활용한 간단한 NPU 체험으로 시작되었습니다. 참가자들은 기존 GPU 환경과 동일한 코드 구조로, 별도의 라이브러리 추가 없이 한 줄의 명령만으로 NPU에서 텐서 연산을 실행했습니다. 이후 Hugging Face Transformers 라이브러리를 그대로 사용해 Phi-3 0.6B 모델을 로드하고 추론을 수행했습니다.

다음 단계에서는 프로덕션 환경 성능 최적화를 위한 Graph Mode 실습이 이어졌습니다. 리벨리온 프로파일러와 Perfetto 시각화 도구를 이용해 NPU 내부 연산 트레이스를 수집하고, 타일 단위 파이프라인 구조를 직접 확인할 수 있었습니다. 참가자들은 Prefill과 Decode 그래프를 별도로 컴파일하며, Flash Attention, KV 캐싱 등 최적화된 커널을 통해 Eager Mode 대비 현저히 빠른 추론 속도를 체감했습니다.

vLLM의 리벨리온 NPU 백엔드 플러그인

본 워크샵의 핵심은 vLLM의 리벨리온 NPU 백엔드 플러그인, 즉 ‘torch.compile 기반 vLLM-RBLN 프레임워크’였습니다. 플러그인은 NPU 상에서 Paged Attention, Continuous Batching을 구현하고, 실제 서비스 배포 환경에서 요구되는 메모리 효율 및 처리 속도 최적화를 지원합니다. 또한 OpenAI API와 호환되는 Endpoint를 제공해, 개발자가 기존 API 워크플로우를 그대로 유지하면서도 리벨리온 하드웨어 성능을 활용할 수 있습니다. 새로운 하드웨어를 도입하더라도 기존 코드 자산과 운영 노하우를 그대로 유지할 수 있다는 점이 참가자들에게 전달되었습니다.

마지막 세션에서는 Mixture-of-Experts(MoE) 모델의 분산 추론 데모가 진행되었습니다. 리벨리온 NPU 상에서 Qwen1.5 MoE 모델을 실행하며, 텐서 병렬화(Tensor Parallelism)와 전문가 병렬화(Expert Parallelism) 구조를 결합한 형태로 시연이 이루어 졌습니다. 리벨리온은 vLLM-RBLN 내 MoE 공식 지원을 준비하고 있고 있으며, 대규모 분산 추론 환경에서 NPU 기반 성능 향상과 확장성을 지속적으로 강화해 나갈 예정입니다.

함께 성장하는 오픈소스 AI 생태계

이번 워크숍은 단순한 데모가 아닌, 쿠버네티스에 기반한 프로덕션 환경 수준의 실습 인프라에서 진행되었습니다. 참가자들은 Hugging Face, PyTorch, vLLM이 리벨리온 NPU 위에서 자연스럽게 통합되는 경험을 직접 체험했습니다. 이번 행사를 시작으로 리벨리온과 스퀴즈비츠는 향후 2년간 vLLM Hands-on Workshop을 정기적으로 운영하며, 국내 개발자들이 vLLM을 기반으로 한 실질적인 서비스 구축 경험을 쌓을 수 있도록 지원할 예정입니다. 리벨리온은 앞으로도 개발자들과 함께 오픈소스 생태계를 확장하며, NPU가 AI 인프라 안에서 안정적으로 자리 잡고, 더 많은 개발자들이 활용할 수 있도록 기술적 기반을 지속적으로 강화해 나갈 것입니다.

Share This: